KI‑gestützte Simulation: Expert‑FAQ zu Optimierung und Data Fusion

Alexander Seidel

24.03.2026

Antworten auf zentrale Fragen zur KI-gestützten Simulation, Optimierung und Datenfusion

Wie lassen sich Messdaten und Simulationen effizient kombinieren? Wann ist ein Surrogatmodell ausreichend genau? Und wie unterstützt generative KI die Designoptimierung? Dr. Alexander Seidel und Dr. Kevin Cremanns, Experten für KI im Engineering, geben praxisorientierte Einblicke in aktuelle Methoden der KI-gestützten Produktentwicklung – von Multi-Fidelity-Modellen über Bayes’sche Optimierung bis hin zu robusten Versionierungsstrategien für komplexe Entwicklungsprozesse.

Zusammenfassung

- Datenfusion für präzisere Modelle: Multi-Fidelity-Ansätze kombinieren Messdaten und Simulationen, um mit wenigen Experimenten robuste, effiziente Modelle zu erstellen.

- Probabilistische Methoden für Unsicherheiten: KI-gestützte Modelle wie Gauß-Prozesse unterscheiden Rauschen von physikalischen Zusammenhängen und erhöhen die Vorhersagequalität.

- Generative KI für Designfreiheit: Nicht-parametrische Optimierung ermöglicht komplexe Geometriekombinationen und erweitert die Möglichkeiten für Multi-Objective-Designs.

Wie können Daten aus Messungen und Simulationen kombiniert werden?

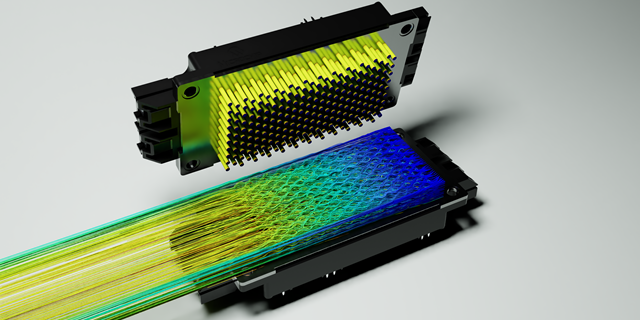

Bei CADFEM nutzen wir Methoden, die verschiedene Datenquellen miteinander verknüpfen. Diese sogenannte Multi-Fidelity-Modellierung ermöglicht es, Messungen aus Experimenten und Ergebnisse aus Simulationen gemeinsam zu verwenden.

Im Experiment werden in der Regel dieselben Größen gemessen, die auch in der Simulation berechnet werden. Es ist jedoch ebenso möglich, unterschiedliche Größen einzubeziehen. Durch die Kombination beider Datenquellen entsteht ein leistungsfähiges Modell, das intern aus den Daten lernt und sowohl Simulationsergebnisse als auch experimentelle Messungen vorhersagen kann.

Der große Vorteil: Schon wenige Experimente reichen aus, um ein fundiertes Modell zu kalibrieren. Ergänzend werden die Experimente genutzt, um Korrelationen zwischen Simulation und Realität zu untersuchen. Die Simulationsdaten hingegen lassen sich kostengünstig und schnell in großer Zahl erzeugen – so entsteht ein Modell, das Effizienz und Genauigkeit vereint.

Wie gehen Sie mit Unsicherheiten bei der Mess- und Simulationsgenauigkeit in Ihrem Workflow um?

Wer mit experimentellen Daten arbeitet, muss in der Regel mit Unsicherheiten rechnen. Durch die Verwendung von probabilistischen Modellen können diese auch bei den Simulationsergebnissen mit verschiedenen Modellqualitäten umgehen, die sich in den Unsicherheiten widerspiegeln. Zwar ist das generell bei Simulationen nicht so gefährlich, aber auch hier treten unter Umständen Singularitäten oder andere Phänomene auf. Folglich ist ein probabilistischer Ansatz hilfreich, denn ein zentraler Bestandteil des Trainings von probabilistischen Modellen besteht darin, tatsächliche Korrelationen in den Daten von statistischen Variationen (Rauschen) zu unterscheiden.

Das ist ein großer Vorteil zum Beispiel gegenüber neuronalen Netzen, die das nicht können. Ein probabilistisches Modell erkennt, dass die Varianz in den Daten vom Rauschen kommt und versucht, die wahre Physik dahinter zu finden.

Welchen Nutzen bringt ein Generatives KI-Modell, wenn es darum geht, ein Optimierungsproblem mit mehreren Zielvariablen (Multi-Objective) zu lösen und ein optimales Design auszuwählen?

Der große Vorteil der Generativen KI besteht darin, dass sie mit einer prädiktiven KI kombiniert werden kann, also einem Modell, das die Ergebnisse für diese Geometrie vorhersagt, ohne dass eine Parametrisierung erfolgen muss. Außerdem ist zu bedenken, dass eine Parametrisierung auch immer eine Einschränkung bezüglich der Geometrie bedeutet. Sobald Sie also eine Geometrie parametrisieren, können Sie nur Geometrien erhalten, die mit dieser Parametrisierung möglich sind.

Wenn Sie eine generative KI in die Geometrieoptimierung einbeziehen, lassen sich Geometrien kombinieren, die auf Basis einer Parametrisierung niemals kombiniert werden könnten, weil keine entsprechende Parametrisierung möglich ist. Deshalb bietet die nicht-parametrische Arbeitsweise eine sehr viel höhere Flexibilität und vielfältigere generative Design-Optionen für die gewünschten Geometrien.

Aber Sie benötigen natürlich Trainingsgeometrien, um das Modell zu trainieren, was Sie bei parametrischen Optimierungen nicht brauchen. Dort können Sie nach der Parametrisierung der Geometrie sofort beginnen.

TIPP: Hype ist gut - aber Nutzen ist besser!

Die Industrie befindet sich an einem revolutionären Wendepunkt: Künstliche Intelligenz (KI) ist nicht länger eine Zukunftsvision, sondern ein greifbarer Wettbewerbsvorteil. Doch wie kann man diese Technologie gezielt und effektiv in der Produktentwicklung einsetzen? Unser eBook gibt Ihnen nicht nur Antworten, sondern liefert praxisnahes Wissen mit wirklichem Mehrwert.

Jetzt eBook runterladen

Wann sollte bei einer Bayes'schen Optimierung mithilfe der wahren Funktion (z. B. FEM-/CFD-Simulation) optimiert werden und wann mithilfe des Surrogatmodells? Wenn wir uns auf das Surrogatmodell verlassen, wie hoch sollte die Vorhersagegenauigkeit (z. B. R²) sein, um mit diesem Ansatz zu arbeiten?

Die Bayes’sche Optimierung kombiniert beides: Surrogatmodell und wahre Funktion. Es handelt sich also nicht um ein Entweder/Oder, sondern um einen iterativen Prozess:

- Start: Zu Beginn liegen nur wenige Datenpunkte vor, z. B. aus fünf initialen FEM-/CFD-Simulationen.

- Surrogatmodell: Auf Basis dieser Daten wird ein probabilistisches Modell (z. B. Gauß-Prozess) trainiert, das die wahre Funktion approximiert und gleichzeitig Unsicherheiten quantifiziert.

- Kandidatenauswahl: Das Surrogatmodell schlägt über eine Akquisitionsfunktion (z. B. Expected Improvement) den nächsten vielversprechenden Designpunkt vor.

- Validierung: Dieser Punkt wird mit der wahren Funktion (Simulation) bewertet. Das Ergebnis fließt zurück ins Modell – und der Zyklus beginnt von vorn.

Die Strategie ist, mit dem Surrogatmodell gezielt neue Simulationen auszuwählen, um so die Versuchsplanung zu steuern. Dabei wird aber jeder Vorschlag immer wieder durch die wahre Funktion validiert. Es ist jedoch auch möglich, nur mit dem Surrogate zu optimieren.

Wie genau muss das Surrogatmodell sein?

Ein hoher R²-Wert (z. B. > 0,9) ist nur dann erforderlich, wenn man sich ausschließlich auf das Surrogatmodell verlassen möchte – z. B. für rein virtuelle Optimierungen ohne Simulationen. In der typischen Bayes’schen Optimierung genügt jedoch ein „ausreichend gutes“ Modell, das die groben Zusammenhänge erkennt und Unsicherheiten berücksichtigt. Schon mit einem R² von 0,7–0,85 kann das Modell effizient zum Optimum führen, da es durch jede neue Simulation verbessert wird.

Wie werden Änderungen an Modellen, Datensätzen und Konfigurationen nachverfolgt?

Das Tracking von Änderungen an Daten, Modellen und Konfigurationen erfolgt immer projektbezogen und individuell. Je nach Kundenanforderungen sind dabei verschiedene Arbeitsweisen denkbar: von einfachen Versionierungsstrategien bis hin zu weiterführenden Machine-Learning-Operations-Workflows. Falls bereits Tools oder Strategien beim Kunden im Einsatz sind, können unsere Modelle flexibel daran angepasst werden. Grundsätzlich lässt sich das auch mit bestehender Software von Ansys realisieren, beispielsweise mit dem Datenmanagementsystem Ansys Minerva, um so eine maßgeschneiderte Lösung zu schaffen.

Ein formales Tracking ist besonders dann sinnvoll, wenn viele Änderungen vorgenommen werden und der Überblick über Modell- und Datenversionen erhalten bleiben soll.

Autor

Alexander Seidel

CADFEM Germany GmbH

+49 (0)8092 7005 320

aseidel@cadfem.de

Redaktion

Klaus Kuboth

CADFEM Germany GmbH

+49 (0)8092 7005-279

kkuboth@cadfem.de